本文基于Windows平台编写,因配置项较多,不同平台差异较大,可能存在不兼容的情况,其他平台请移步网络其他文章。

安装并配置LM Studio

下载安装包并安装

设置语言为简体中文

最新版本的LM Studio已经支持设置简体中文,但本地化程度很低。

设置路径:左下角⚙️-Settings-General-User Interface-语言

更换镜像源(不过我实测貌似没作用)

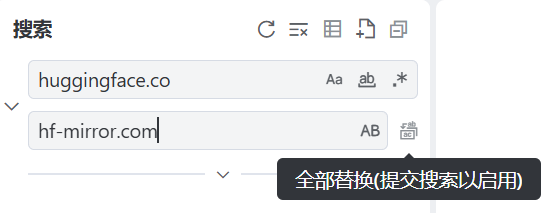

打开LM Studio安装目录,进入目录.\resources\app\.webpack,通过Trae打开该目录,搜索替换huggingface.co->hf-mirror.com(Trae操作路径:编辑-在文件中替换)

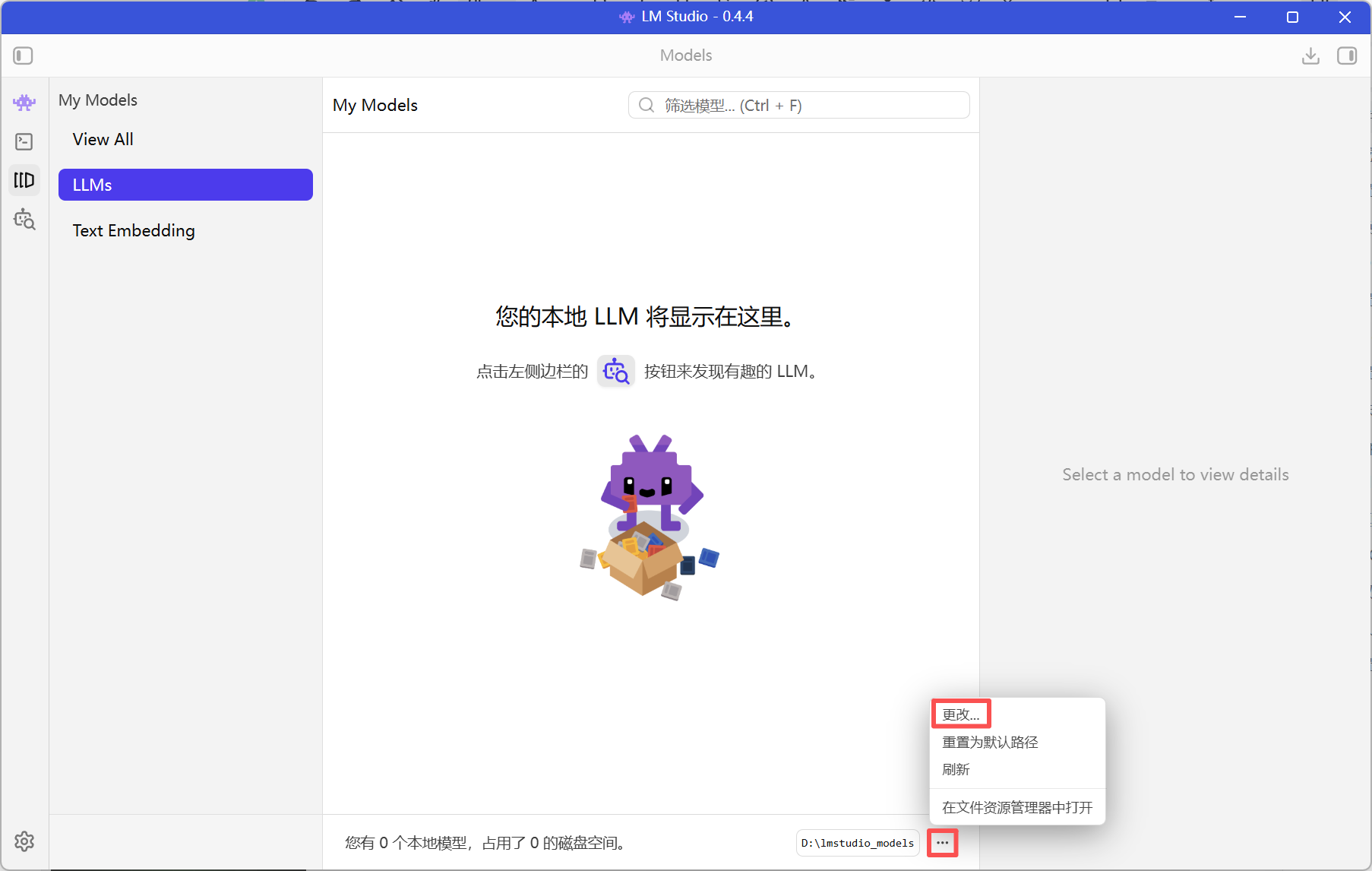

更改模型下载目录

设置路径:My Models-右下角三个点-更改...

部署OpenClaw

前置条件

Node.js v22或更新版本

便捷下载链接:https://nodejs.org/dist/v24.14.0/node-v24.14.0-x64.msi(2026年2月25日最新的官方安装包)

下载安装即可,勾选接受协议选项,其他保持默认。

Windows自动安装脚本

iwr -useb https://openclaw.ai/install.ps1 | iex配置OpenClaw

需要安装自启动服务:

openclaw onboard --install-daemon仅配置,不安装自启动服务:

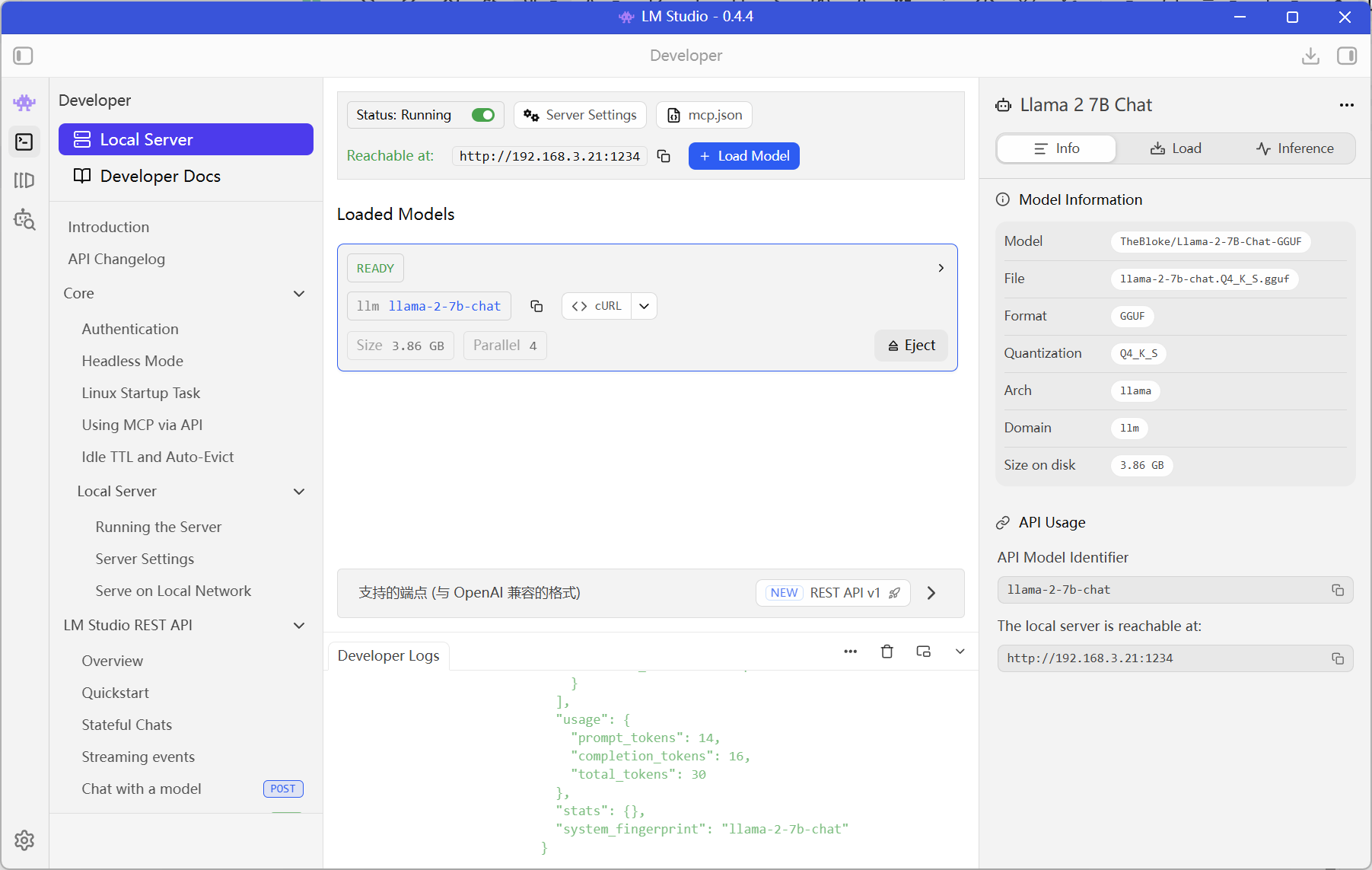

openclaw onboard开始配置(请确保LM Studio-Developer-Local Server保持运行状态):

I understand this is powerful and inherently risky. Continue?选择> YesOnboarding mode选择> ManualWhat do you want to set up?选择> Local gateway (this machine)Workspace directory保持默认C:\Users\用户名\.openclaw\workspaceModel/auth provider按键盘↑按键2次选择Custom ProviderAPI Base URL填写http://127.0.0.1:1234/v1API Key (leave blank if not required)填写前面复制的sk-lm-7yitFilA:4IIXaynFO2mKCQLasEtFEndpoint compatibility选择> OpenAI-compatibleModel ID可以填写default(这个ID主要是给OpenClaw内部识别用的。LM Studio实际上会忽略这个值,直接运行你当前加载的模型。)Endpoint ID保持默认custom-127-0-0-1-1234Model alias (optional)可以直接Enter跳过Gateway port保持默认18789Gateway bind选择> LAN (0.0.0.0)Gateway auth选择> TokenTailscale exposure选择> OffGateway token (blank to generate)留空即可Configure chat channels now?选择> NoConfigure skills now? (recommended)选择> NoEnable hooks?选择🚀 boot-md, 📎 bootstrap-extra-files, 📝 command-logger, 💾 session-memory(按空格键选择,按回车键提交)Gateway service runtime选择> Node (recommended)

以上已完成基础配置,无需理会系统后续操作,直接关闭命令行窗口。

OpenClaw会自动使用默认浏览器打开OpenClaw的网关界面,如网关未启动,可使用以下命令启动:

openclaw gateway特殊配置

OpenClaw网关启动错误

Gateway failed to start: Error: non-loopback Control UI requires gateway.controlUi.allowedOrigins (set explicit origins), or set gateway.controlUi.dangerouslyAllowHostHeaderOriginFallback=true to use Host-header origin fallback mod

由于Gateway bind选择了LAN模式,导致OpenClaw的Control UI服务没有运行在本地回环地址(如127.0.0.1或localhost)上,而是监听在局域网IP(如192.168.x.x),但是浏览器安全策略(CORS)要求明确允许跨域请求的来源(origin),阻止来自不同源(如127.0.0.1或localhost)的网页访问该服务。

解决方案:

在C:\Users\用户名\.openclaw路径下找到openclaw.json,往下滑找到这个区域:

"gateway": {

"port": 18789,

"mode": "local",

"bind": "lan",

// 添加以下三行

"controlUi": {

"dangerouslyAllowHostHeaderOriginFallback": true

},

"auth": {

"mode": "token",

"token": "xxxxxxxxxxxxxxxxxxxxxx"

},

"tailscale": {

"mode": "off",

"resetOnExit": false

},

"nodes": {

"denyCommands": [

"camera.snap",

"camera.clip",

"screen.record",

"calendar.add",

"contacts.add",

"reminders.add"

]

}

},网关令牌缺失

首先打开C:\Users\用户名\.openclaw\openclaw.json,在gateway.auth找到token复制到剪贴板。

然后在Control UI-概览-网关访问-网关令牌填入token,点击连接。

模型上下文窗口不足

⚠️ Agent failed before reply: Model context window too small (4096 tokens). Minimum is 16000.

Logs: openclaw logs --follow

打开C:\Users\用户名\.openclaw\openclaw.json:

"models": {

"mode": "merge", // <--- 关键:告诉系统以我的配置为准进行合并

"providers": {

"custom-127-0-0-1-1234": {

"baseUrl": "http://127.0.0.1:1234/v1",

"apiKey": "sk-lm-avvShhvm:W7y0B2E0MHxwkmdSZFrC",

"api": "openai-completions",

"models": [

{

"id": "default",

"name": "default (Custom Provider)",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

// 👇 核心修改在这里 👇

"contextWindow": 128000,

"maxTokens": 32000

}

]

}

}

},OpenClaw接入第三方API接口

本地大模型对配置要求高?上下文长度太小?快试试第三方API吧!

获取第三方API

点击下方链接注册并充值,然后在“令牌管理”页面创建令牌KEY并复制。

接入第三方API

在终端执行以下命令:

openclaw onboard --install-daemon开始配置:

I understand this is powerful and inherently risky. Continue?选择> YesOnboarding mode选择> QuickStartConfig handling选择> Use existing valuesModel/auth provider按键盘↑按键2次选择Custom ProviderAPI Base URL输入https://api.aaai.vip/v1API Key (leave blank if not required)输入刚刚复制的sk-开头的令牌密钥Endpoint compatibility选择> OpenAI-compatibleModel ID必须正确填写,如gemini-3-flash-preview(模型名称可参考:https://api.aaai.vip/models)Endpoint ID保持默认custom-api-aaai-vip其他配置项同上

Gateway service already installed选择> Restart

完成后,打开C:\Users\用户名\.openclaw\openclaw.json,我们发现程序自动添加了刚刚配置的新模型,原来的本地大模型API和其他设置项没有发生变化。最后,记得更改contextWindow值为128000,maxTokens值为32000。

配置模型故障转移(可选)

打开C:\Users\用户名\.openclaw\openclaw.json:

{

"agents": {

"defaults": {

"model": {

"primary": "zai/glm-5",

"fallbacks": ["zai/glm-4.7", "zai/glm-4.6", "zai/glm-4.5-air"]

}

}

}

}